- OpenAI가 AMD, Broadcom, Intel, Microsoft, NVIDIA와 공동으로 MRC 프로토콜을 개발했습니다.

- 이 기술은 수백 개의 경로를 동시에 사용하여 10만 개 이상의 GPU를 단 2개의 스위치 레이어만으로 연결합니다.

- 현재 OpenAI의 스타게이트(Stargate) 슈퍼컴퓨터에 성공적으로 적용되어 인프라 효율성을 입증했습니다.

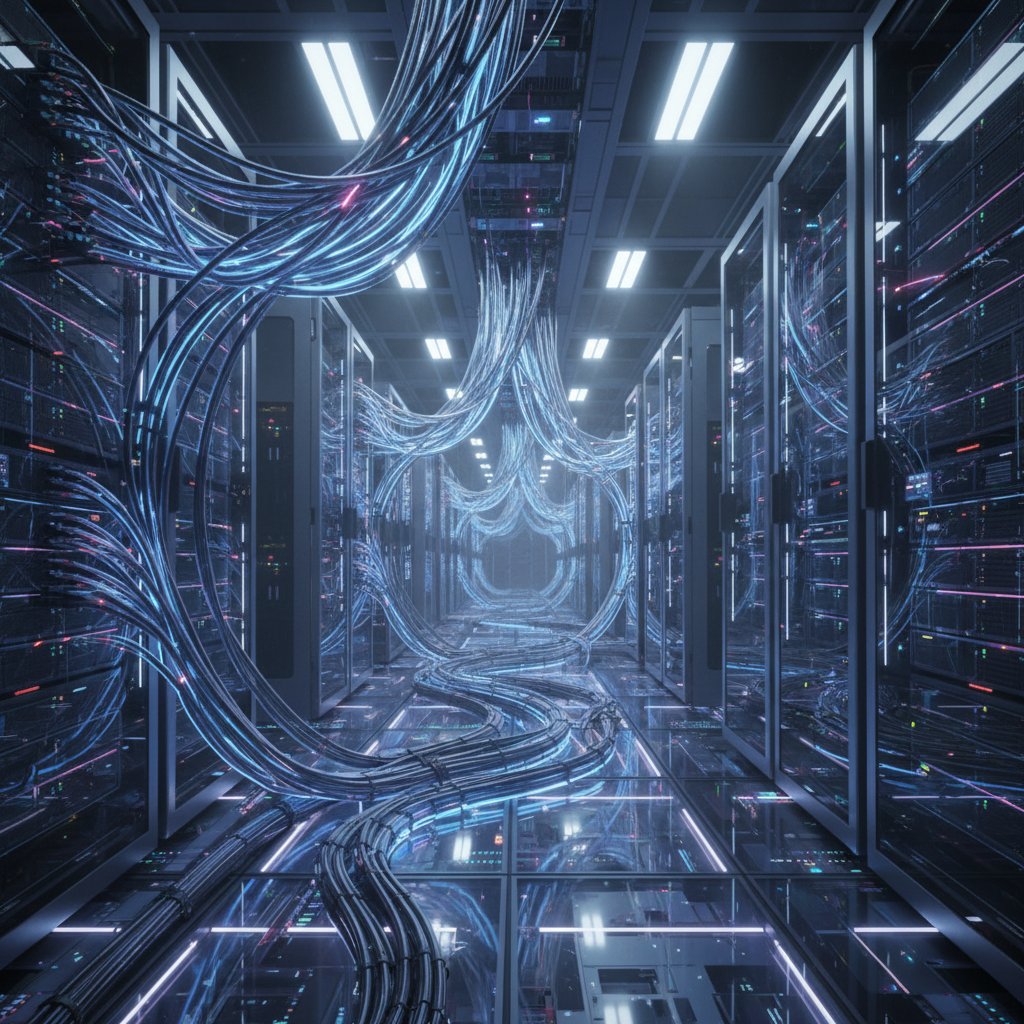

데이터센터의 네트워크 병목 현상은 이제 더 이상 기술적 난제가 아닌 생존의 문제입니다. 기존의 다층 스위치 구조는 대규모 AI 모델 학습 시 엄청난 전력 낭비와 물리적 지연을 유발해 왔습니다. 과거의 방식은 거대한 파라미터를 처리해야 하는 생성형 AI(Generative AI) 환경에서 더 이상 유효하지 않습니다. 변화는 이미 시작되었습니다. 이제 하드웨어의 성능을 온전히 끌어내기 위한 네트워크 최적화가 필수적인 시대가 되었습니다.

MRC 프로토콜은 단순히 경로를 늘리는 것을 넘어 데이터 흐름의 구조를 혁신합니다. 수백 개의 데이터 경로를 동시 다발적으로 활용함으로써 스위치 레이어를 극단적으로 줄였습니다. 이는 신호 지연을 최소화하고 인프라 구축에 드는 고비용 구조를 깨뜨리는 강력한 촉매제입니다. 10만 개가 넘는 GPU를 효율적으로 동기화하는 능력은 AI 모델 학습의 속도를 비약적으로 높일 것입니다.

데이터센터 네트워크의 패러다임 전환

기존 네트워킹은 계층이 많아질수록 데이터가 길을 잃거나 지연되는 현상이 빈번했습니다. 하지만 MRC 프로토콜은 이를 불과 2개의 레이어로 압축합니다. 물리적 스위치 개수를 줄이면 전력 소비가 비약적으로 감소합니다. 실리콘밸리의 거인들이 이 기술에 주목하는 이유는 명확합니다. AI 컴퓨팅 파워는 하드웨어의 양보다 그 하드웨어를 어떻게 묶어서 운용하느냐에 따라 결정되기 때문입니다.

비즈니스적 시사점과 시장 파급력

한국의 IT 기업들은 이제 GPU 확보 경쟁을 넘어 네트워크 효율성 경쟁에 대비해야 합니다. MRC 프로토콜은 인프라 효율성을 높여 같은 비용으로 더 많은 연산을 수행할 수 있게 합니다. 이는 클라우드 서비스 제공업체(CSP)뿐만 아니라 대규모 온프레미스 인프라를 구축하는 기업들에게 엄청난 비용 절감 기회입니다. 인프라의 표준이 오픈 소스로 이동한다는 점은 우리에게도 기술 주도권을 확보할 수 있는 새로운 기회의 창을 열어줄 것입니다.

비판적 시각과 기술적 리스크

물론 장밋빛 전망만 있는 것은 아닙니다. MRC 프로토콜이 보편적인 표준으로 자리 잡기 위해서는 이기종 하드웨어 간의 완벽한 호환성이 담보되어야 합니다. 또한, 기존 네트워크 장비 생태계를 장악하고 있는 업체들의 반발이나 기술적 복잡성으로 인한 초기 오류 가능성을 배제할 수 없습니다. 지나친 표준화가 기술의 다양성을 저해할 위험도 존재합니다. 이러한 리스크를 면밀히 분석하지 않는다면 기술 전환의 비용이 예상보다 커질 수 있습니다.

결국 인프라의 효율은 속도와 비용, 이 두 가지 핵심 지표로 회귀합니다. MRC 프로토콜의 등장은 데이터 처리 방식의 근본적인 효율화를 의미합니다. 지금 당장 여러분의 데이터센터 아키텍처를 점검하고, 이 혁신적인 네트워크 프로토콜이 가져올 변화를 대비하십시오. 기술적 우위는 머뭇거리는 자가 아닌, 새로운 흐름에 올라타는 자의 몫입니다. 지금 바로 실행하십시오.

심층 분석 및 시사점

MRC 프로토콜은 멀티패스 데이터 전송을 통해 병목 구간을 원천적으로 차단하며, 스위치 레이어 최소화로 지연 시간을 획기적으로 낮춥니다. 인프라 구축의 물리적 복잡도를 획기적으로 줄여 전력 효율과 비용 절감을 동시에 달성하며, 대규모 GPU 클러스터에서 높은 처리량(Throughput)을 보장합니다. 오픈 소스 기반으로 이기종 간 하드웨어 연동성을 강화하여 특정 벤더 종속성을 낮추는 구조를 가집니다.