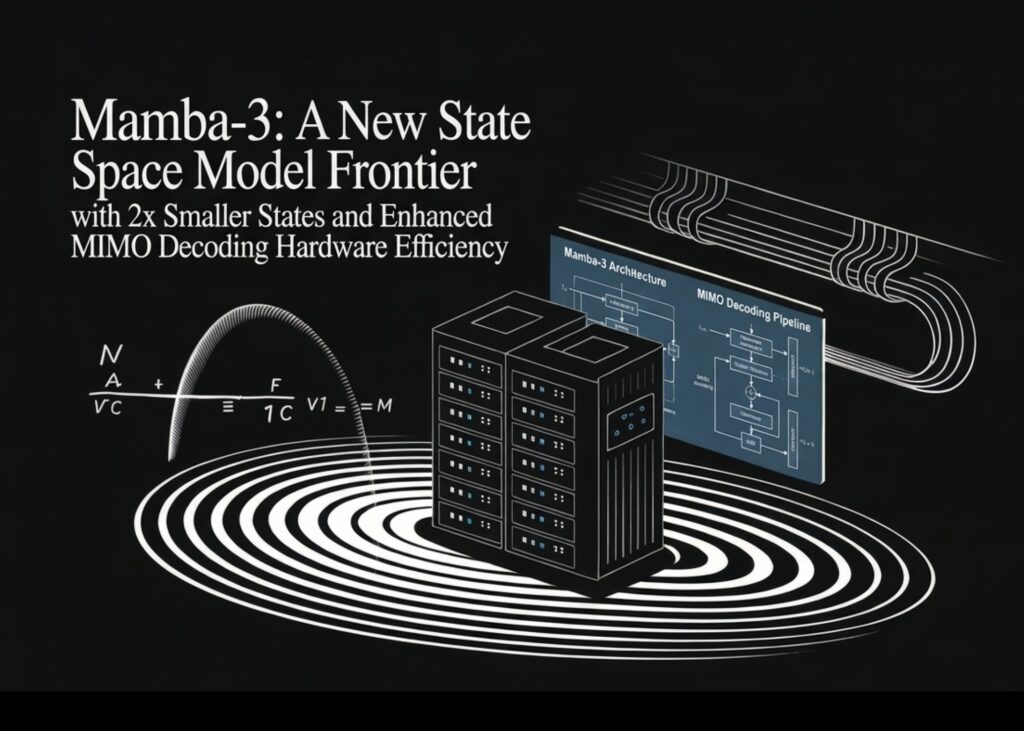

Mamba-3: 2배 작은 상태 크기와 향상된 MIMO 디코딩 하드웨어 효율을 갖춘 새로운 상태 공간 모델 프론티어

최근 대규모 언어 모델(LLM)의 성능 향상을 위해 추론 시간 컴퓨팅 스케일링이 핵심적인 요소로 부상하면서, 모델 품질과 함께 추론 효율성을 고려한 아키텍처 설계에 대한 관심이 높아지고 있습니다. 기존 트랜스포머 기반 아키텍처는 여전히 널리 사용되고 있지만, 그 특유의 2차 복잡도 계산량과 선형 메모리 요구 사항은 배포 과정에서 상당한 병목 현상을 야기합니다. 이러한 문제를 해결하기 위해 Carnegie Mellon University(CMU), Princeton University, Together AI, Cartesia AI의 연구팀은 추론 우선 설계(‘inference-first’ design)를 통해 이러한 제약 조건을 해결하는 Mamba-3 모델을 발표했습니다.

본 기사에서는 Mamba-3 모델의 주요 특징과 기술적 혁신, 그리고 이 모델이 IT 업계에 미치는 영향과 미래 전망을 심층적으로 분석합니다. 특히, Mamba-3는 기존 모델들과 비교하여 어떤 차별성을 가지며, 어떤 장점을 제공하는지 면밀히 살펴보겠습니다.

1. Mamba-3의 핵심 기술: State Space Model (SSM) 기반 업데이트

Mamba-3는 State Space Model (SSM) 프레임워크를 기반으로 구축되었으며, 다음과 같은 세 가지 핵심 방법론적 업데이트를 포함합니다. 이 업데이트들은 기존 모델의 한계를 극복하고 추론 효율성을 극대화하는 데 기여합니다.

1.1. 지수-사다리꼴 분산 (Exponential-Trapezoidal Discretization)

상태 공간 모델은 연속 시간 시스템이므로 처리되는 이산 시퀀스를 처리하기 위해 이산화해야 합니다. Mamba-1 및 Mamba-2와 같은 이전 버전은 ‘지수-오일러’ 분산이라는 1차 헤uristic을 사용했습니다. Mamba-3는 이를 지수-사다리꼴 분산으로 대체하여 상태-입력 적분의 2차 정확도 근사를 제공합니다.

기술적으로 이 업데이트는 2항 업데이트에서 3항 업데이트로 재귀를 변경합니다:

h_{t}=e^{ riangle_{t}A_{t}}h_{t-1}+(1- ext{λ}_{t}) riangle_{t}e^{ riangle_{t}A_{t}}B_{t-1}x_{t-1}+ ext{λ}_{t} riangle_{t}B_{t}x_{t}이 공식은 핵심 재귀 내에서 상태-입력 Btxt에 대한 데이터 종속, 너비-2 컨볼루션을 적용하는 것과 같습니다. 경험적 테스트에서 이 암시적 컨볼루션은 가르쳐진 B 및 C 편향과 함께 기존의 재발 모델에서 일반적으로 요구되는 외부 짧은 인과 컨볼루션 없이 Mamba-3가 효과적으로 작동하도록 합니다. 이러한 혁신적인 접근 방식을 통해 Mamba-3는 더욱 효율적인 추론을 가능하게 합니다.

1.2. 복소수 상태 공간 모델과 ‘RoPE 트릭’

실수 값 선형 모델의 한 가지 제한 사항은 ‘상태 추적’ 작업, 예를 들어 비트 시퀀스의 패리티를 결정하는 것과 같은 작업을 해결할 수 없다는 것입니다. 이는 전이 행렬의 고유값이 실수로 제한되어 그러한 작업에 필요한 ‘회전’ 역학을 나타낼 수 없기 때문입니다. Mamba-3는 이러한 문제를 해결하기 위해 복소수 SSM을 통합합니다. 연구팀은 이산화된 복소수 SSM과 B 및 C 투영에 데이터 종속 Rotary Positional Embeddings (RoPE)를 사용하는 실수 값 SSM 간의 이론적 등가성을 확립했습니다.

‘RoPE 트릭’을 사용하여 모델은 시간 단계에 걸쳐 집계된 데이터 종속 회전을 적용합니다. 이를 통해 Mamba-3는 Mamba-2 및 실수 값 변형이 무작위 추측보다 더 나은 성능을 내지 못하는 Parity 및 Modular Arithmetic와 같은 합성 작업을 해결할 수 있습니다. 이 기술은 Mamba-3의 성능을 향상시키는 중요한 요소입니다.

1.3. 다중 입력, 다중 출력 (MIMO) 공식

메모리 바운드 디코딩의 하드웨어 비효율성을 해결하기 위해 Mamba-3는 단일 입력 단일 출력 (SISO) 재귀에서 다중 입력 다중 출력 (MIMO) 구조로 전환했습니다. 표준 SSM 디코딩에서 산술 강도는 약 2.5 ops/바이트로 현대적인 GPU인 H100의 컴퓨트 바운드 영역보다 훨씬 낮습니다. MIMO는 상태 크기가 일정할 때 입력 및 출력 투영 (Bt E RNR 및 xt E RPR)의 랭크 R을 변환하여 상태 업데이트를 외적에서 행렬-행렬 곱셈으로 변경하여 디코딩 FLOP을 최대 4배 증가시킵니다. 이 추가 계산은 상태 업데이트에 필요한 기존 메모리 I/O와 겹쳐지므로 MIMO는 모델링 품질과 퍼플렉시티를 개선하는 동시에 유사한 벽시계 디코딩 지연을 유지합니다.

2. Mamba-3의 아키텍처 및 정규화

Mamba-3 블록은 Llama 스타일 레이아웃을 따르며 SwiGLU 블록과 교번합니다. 주요 개선 사항은 다음과 같습니다:

- BC/QK 정규화: B 및 C 투영에 RMS 정규화가 적용되어 트랜스포머의 QKNorm을 반영합니다. 이를 통해 훈련이 안정화되고 이전 버전에서 사용된 사후 게이트 RMSNorm을 제거할 수 있습니다.

- 헤드별 편향: B 및 C 구성 요소에 가르쳐진 채널별 편향을 추가하여 컨볼루션과 같은 동작을 유도합니다.

- 하이브리드 통합: 선형 레이어와 자가 주의를 혼합하여 사용되는 하이브리드 아키텍처에서 사전 게이트 그룹 RMSNorm을 추가하면 검색 작업에서 길이 일반화가 향상되었습니다.

3. 결과 및 효율성

FineWeb-Edu 데이터 세트에서 4가지 모델 규모(180M에서 1.5B)로 평가가 수행되었습니다.

- 다운스트림 성능: 1.5B 규모에서 SISO Mamba-3 변형은 Mamba-2 및 Gated DeltaNet (GDN)보다 성능이 뛰어납니다. R=4의 MIMO 변형은 SISO 기준선을 평균 1.2점 개선합니다.

- 파레토 프론티어: Mamba-3는 Mamba-2와 동일한 사전 훈련 퍼플렉시티를 달성하면서 상태 크기를 절반으로 줄이는 데 성공합니다(예: 상태 크기가 64인 Mamba-3는 128인 Mamba-2와 일치).

- 커널 성능: 최적화된 Triton (사전 채우기용) 및 CuTe DSL (디코딩용) 커널을 통해 추가적인 수학적 구성 요소가 가벼워집니다. SISO Mamba-3 커널은 표준 BF16 설정에서 릴리스된 Mamba-2 및 GDN 커널보다 낮은 지연 시간을 보여줍니다.

4. Mamba-3가 가져올 미래 전망과 IT 산업에 미치는 영향

Mamba-3는 상태 공간 모델에 대한 근본적인 관점 조정이 이론적 하위 2차 효율성과 실질적인 모델링 기능 간의 격차를 해소할 수 있음을 보여줍니다. Mamba-3는 기존 트랜스포머 기반 모델의 한계를 극복하고 추론 효율성을 극대화하는 데 기여할 수 있으며, 이는 LLM의 배포 비용을 절감하고 접근성을 높이는 데 중요한 역할을 할 것으로 예상됩니다. 또한, Mamba-3는 새로운 Mamba-3 기반 아키텍처 개발과 관련된 연구를 촉진하여 인공지능 분야의 혁신을 가속화할 것으로 기대됩니다. 특히, 낮은 리소스 환경에서도 LLM을 사용할 수 있게 함으로써 다양한 분야에서 활용될 수 있는 가능성을 열어줄 것입니다.

Mamba-3의 성공은 IT 산업 전반에 걸쳐 더 많은 연구와 투자를 유도할 것이며, 이는 더욱 발전된 AI 모델과 기술의 개발로 이어질 것입니다. 결론적으로, Mamba-3는 인공지능 분야에 중요한 이정표를 세웠으며, 미래의 발전 방향을 제시하는 중요한 계기가 될 것입니다.

자세한 내용은 Paper, GitHub Page and Technical details를 참조하십시오. 또한, Twitter 팔로우 및 120k+ ML SubReddit 가입 및 뉴스레터 구독을 잊지 마십시오. 기다려주세요! 텔레그램에서도 저희를 팔로우할 수 있습니다.

The post Meet Mamba-3: A New State Space Model Frontier with 2x Smaller States and Enhanced MIMO Decoding Hardware Efficiency appeared first on MarkTechPost.

심층 분석 및 시사점

Array

한국어

한국어  English

English