精密回帰分析:過剰な特徴量が引き起こす生産性脆弱性の定量化

近年、人工知能モデルの複雑性が増大するにつれて、単純にモデルの性能を高めるために、より多くの特徴量を追加するアプローチが広く使用されています。しかし、外見上、ポジティブな効果のみがあるように見える場合でも、実際には隠れた構造的リスクを引き起こす可能性があるという点を軽視してはなりません。モデルがより多くの情報を学習すれば、より良い予測ができるという直感は、しばしば現実との乖離を生み出し、予期せぬ問題を発生させます。

本記事では、精密回帰モデルにおいて過剰な特徴量の追加が、むしろモデルの信頼性を低下させる可能性があるという点を批判的に分析し、その理由と解決策を詳細に議論します。単純に精度を高めるための盲目的な特徴量追加は、モデルの安定性を損ない、生産性脆弱性を増加させる可能性があるという点を強調し、実際の事例を通してその危険性を明確に示すでしょう。また、過剰な特徴量を削除し、モデルを簡潔にすることの重要性と、それによって得られる利点を詳しく説明します。特徴量 エンジニアリングの重要性とともに、モデルの安定性と信頼性を確保するための不可欠な考慮事項を提示します。

特徴量追加がもたらす隠れたリスク:構造的脆弱性

特徴量をを追加する行為は、単にモデルの複雑性を増大させるだけでなく、上位のデータパイプライン、外部システム、データ品質検証など、多様な要素への依存性を高める結果を招きます。小さな変化、例えば欠落したフィールド、スキーマの変更、遅延したデータセットの一つでも、予測精度を低下させる可能性があります。このような構造的脆弱性は、モデルの維持管理をより困難にし、予測結果の信頼性を低下させる可能性があります。

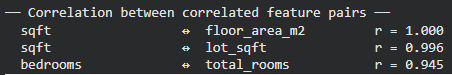

係数の不安定性と意味のない影響力の分散

特徴量を無差別に増加させることは、計算コストの増加やシステム複雑性の増加以上の問題を招きます。まさに特徴量 間の相関関係によって引き起こされる係数の不安定性の問題です。特に、相関が高い、あるいは情報量の少ない特徴量の場合は、最適化過程においてモデルが影響力を適切に分散することが難しく、係数が予測不可能に変動する可能性があります。これはモデルの複雑性を増大させ、解釈可能性を阻害し、予測結果の一貫性を低下させる主要な原因となります。弱い信号を持つ変数列は、実際には無意味なパターンを示すノイズである可能性が高いにも関わらず、重要であると認識される可能性があります。結局、このような過程は、紙の上では洗練されているように見えるものの、実際には一貫性のない予測をするモデルを作り出します。

生産性脆弱性と維持管理の困難さ

過剰な特徴量 は、モデルの生産性脆弱性を増加させます。新しいデータが入力されるたびに、モデルは既存データに合わせて自身を調整する必要があります。その際、不要な特徴量が多いほど、モデルはより多くの変数を考慮しなければならず、これはモデルの安定性を損ない、予測結果の一貫性を低下させます。また、不要な特徴量はモデルの維持管理を困難にします。各特徴量に対する理解度が低い場合、モデルの動作方法を把握することが難しくなり、エラー発生時に原因の特定と修正が遅れる可能性があります。特徴量 を削減することは、モデルの性能を向上させ、生産性を高めることに貢献できます。

事例研究:不動産価格予測モデル

本記事では、不動産価格予測モデルを用いて、過剰な特徴量がモデルの信頼性に及ぼす影響を具体的に示します。大規模データセットで多数の特徴量を含むモデルと、少数の主要な特徴量のみを使用するモデルを比較分析し、過剰な特徴量 がモデルの安定性をどのように損なうかをシミュレーションします。相関する特徴量ペア間の相関関係、弱い信号が実際のパターンと誤認される現象、そして各特徴量の追加が生産性脆弱性をどのように増加させるかを明確に示します。

結論:簡潔さと安定性のバランス

モデルの精度を高めるための盲目的な特徴量 追加は、むしろモデルの信頼性を低下させ、生産性脆弱性を増加させる可能性があります。モデルを開発する際には、精度だけでなく、安定性、維持管理容易性、解釈可能性など、多様な要素を総合的に考慮する必要があります。不要な特徴量を削除し、モデルを簡潔にすることは、モデルの性能を向上させ、予測結果の信頼性を高める上で不可欠なプロセスです。

結論として、精密回帰モデルを構築する際には、特徴量 エンジニアリングの重要性を認識し、モデルの安定性を確保するための努力を継続する必要があります。過剰な特徴量はモデルの複雑性を増大させ、予測結果の一貫性を低下させ、維持管理を困難にします。簡潔さと安定性のバランスを維持することが、成功するモデル開発の鍵となります。

深層分析および示唆事項

Array

<div class=

日本語

日本語  한국어

한국어 English

English