LLM推論の限界:なぜ最先端モデルですら苦労するのか?

最近のChatGPT、Gemini、Claudeなどの大規模言語モデル(LLM)の進歩は目覚ましいものがあります。コーディング、翻訳、テキスト要約など、さまざまなタスクを実行し、人間と似た能力を示しますが、LLMの核心的な能力である「推論(Reasoning)」は依然として未熟な面があります。特に、新しい証拠に基づいて信念を更新する「確率的推論(Probabilistic Reasoning)」能力は深刻なレベルです。これは、熟練したフライト予約アシスタントがユーザーの好みを把握して最適な航空편を推薦しなければならないにもかかわらず、最初の要求以降に学習できない状況と 같습니다.

Google研究チームの最近の研究は、このような問題点を指摘し、現在のLLMが実際の世界の複雑さを十分に理解していないことを明らかにしています。Llama-3-70B、Qwen-2.5-32Bなどの最新モデルですら、初期の相互作用以降、学習能力が停滞する現象を示しました。これはLLMが単にテキストデータを暗記し、パターンを認識することに長けているが、実際の世界の不確実性を理解し、それに応じて判断を下す能力が不足していることを意味します。

ベイズ教育:LLMに「賢い推測」を教える新しいアプローチ

従来のLLM学習方式は、「正しい答え」を提供するのに集中していました。まるで生徒に正解を丸暗記させるようなものです。しかし、Google研究チームはLLMに正解を知らせる代わりに、「賢い推測(Educated Guess)」をさせる「ベイズ教育(Bayesian Teaching)」という新しい手法を提案しました。ベイズ教育は、ユーザーの好みを推測するベイズアシスタントの推論過程を模倣するようにLLMを訓練することです。

ベイズアシスタントは、以前の情報(Prior)と新しい証拠(Likelihood)を組み合わせて、ユーザーの好みに基づく確率分布を更新します。このような過程を通じて、LLMは単に正解を暗記するのではなく、不確実性を理解し推論する能力を獲得します。これは、数学者が問題解決過程でいくつかの仮説を立て、実験結果を通して仮説を修正していくことに似ています。

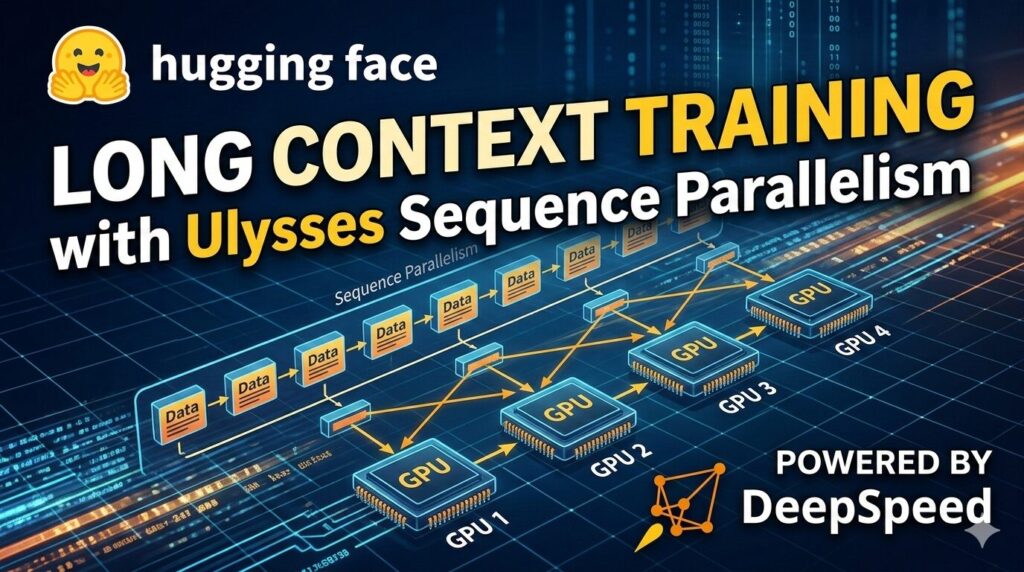

ベイズ教育方式は、教師あり微調整(Supervised Fine-Tuning, SFT)を通じて実現されます。SFTは、従来のデータに加えて、ベイズアシスタントとLLM間の相互作用データを活用してモデルを訓練する方式です。これにより、LLMはベイズアシスタントの推論過程を模倣し、不確実性の中で合理的な判断を下す能力を向上させることができます。

正答よりも「賢い推測」:なぜベイズ教育がより効果的なのか?

驚くべきことに、ベイズ教育は従来の正答データに基づく学習(Oracle Teaching)よりも優れたパフォーマンスを示しました。Oracle Teachingは、LLMに完全に正解を知らせるモデルを基に学習させる方式です。しかし、Oracle Teachingはモデルがユーザーの実際の好みを十分に反映できないという欠点があります。一方、ベイズ教育はモデルが初期段階でエラーを犯しますが、これらのエラーを通して学習し改善していく過程を経験します。これは、子供が転んで立ち上がる過程を通して転ばない方法を学ぶことに似ています。

ベイズ教育を通して訓練されたモデル(例:Gemma-2-9B、Llama-3-8B)は、既存モデルよりもはるかに高い精度を示し、ベイズ戦略と類似した方法で判断する割合が80%に達しました。これはLLMが単に正解を暗記するのではなく、推論過程を理解し、適用できるようになったことを意味します。これらの結果は、LLM推論能力向上に向けた新たな可能性を示し、今後LLMの活用範囲をより拡大できる基盤を 마련했습니다.

さまざまな分野への拡張:LLM推論能力の一般化

Google研究チームは、LLMの推論能力が特定の分野(例:フライト推薦)にのみ限定されず、さまざまな分野に一般化できるかどうかを確認するために、さまざまな実験を行いました。ホテル推薦、ウェブショッピングなど他の分野のデータに適用した結果、ベイズ教育を通して訓練されたモデルは驚くほど、既存モデルよりもはるかに優れたパフォーマンスを示しました。特に、ウェブショッピング作業では人間参加者よりも良い結果を 보이기도 했습니다. これはLLMが推論過程を理解し、これをさまざまな状況に適用できるようになったことを示しています。

このような一般化能力は、LLMが単なるデータ処理ツールを超えて、人と協力して複雑な問題を解決するパートナーとして機能する可能性を示しています。今後、LLMはウェブ検索、製品推薦、顧客サービスなど、さまざまな分野で人間の知能を補完し、より良い意思決定を支援する役割を果たすと 예상됩니다。

技術的な示唆点および将来展望

この研究は、シンボリックモデル(Symbolic Model)とディープラーニングモデル(Deep Learning Model)の融合可能性を示す重要な事例です。シンボリックモデルは明確なルールと論理に基づいて動作しますが、複雑で変化する実際の世界の課題を解決するのに苦労します。一方、ディープラーニングモデルは膨大なデータを介してパターンを学習し予測するのに優れています。しかし、ディープラーニングモデルは時々「ブラックボックス」のように作用し、その推論過程を理解するのが困難です。ベイズ教育はシンボリックモデルの推論能力をディープラーニングモデルに融合し、より強力で説明可能なAIシステムを構築する可能性を 열어줍니다. 今後、LLM推論能力向上はAI技術進歩の核心的な課題となり、さまざまな分野で革新的なサービスを創出するのに寄与すると 예상됩니다。

核心的な技術的示唆点

- LLMは確率的推論能力が不足しており、これは相互作用能力を制限します。

- ベイズ教育はLLMに「賢い推測」を教え、推論能力を向上させます。

- LLM推論能力はさまざまな分野に一般化でき、ウェブショッピングのような複雑な作業にも適用可能です。

- LLMは人間の偏りや不注意によるエラーに、より強靭です。

- シンボリック推論戦略をLLMに効果的に融合し、より強力で説明可能なAIシステムを構築できます。

結論:LLM推論の未来は「ベイズ」だ

Googleのベイズ教育手法は、LLM推論能力向上に向けた重要な転換点となるでしょう。これは単なる技術的な改善を超えて、AIが人とより効果的に協力し、複雑な問題を解決するために必要な根本的な能力を提供します。今後、LLM推論能力はAI技術進歩の核心的な課題となり、さまざまな分野で革新的なサービスを創出するのに寄与すると 예상됩니다. 今後、より多くの研究と開発を通してLLM推論能力がより発展し、AIが人間の生活に肯定的な影響を与えるように努力해야 합니다。</li

詳細な分析および示唆

Array

原文出処:The ‘Bayesian’ Upgrade: Why Google AI’s New Teaching Method is the Key to LLM Reasoning

日本語

日本語  한국어

한국어 English

English