AI 개발의 가속화: 과거와 현재의 격차를 뛰어넘다

인공지능(AI) 개발은 지금껏 경험하지 못할 정도로 빠르게 발전하고 있습니다. 불과 몇 년 전만 해도 AI 모델 훈련에는 엄청난 시간과 자원이 필요했습니다. 복잡한 알고리즘을 구현하고, 방대한 데이터를 수집하고, 이를 기반으로 모델을 학습시키는 과정은 기업은 물론 개인 개발자에게도 큰 부담이었습니다. 하지만 지금은 어떻습니까? 하드웨어의 성능 향상, 소프트웨어 최적화, 그리고 더 나은 데이터셋의 활용으로 훈련 시간이 획기적으로 단축되었습니다.

예를 들어, 과거에는 몇 주가 걸리던 훈련 작업을 이제는 몇 시간 안에 완료할 수 있게 되었죠. 이러한 변화는 AI 기술의 대중화를 이끌고 있으며, 더 많은 사람들이 AI 개발에 참여할 수 있는 환경을 조성하고 있습니다. 특히, 개인 연구자나 소규모 기업에게는 더욱 희소식입니다. 이제 누구든 강력한 AI 모델을 훈련하고 실험해 볼 수 있는 기회가 열린 것이죠.

Nanochat, GPT-2 모델 훈련의 새로운 지평을 열다

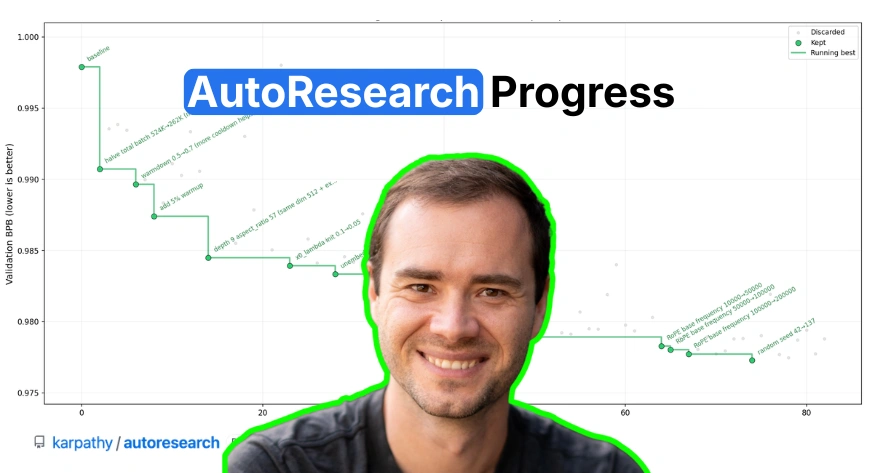

최근 AI 연구자 Andrej Karpathy의 업데이트를 통해 이러한 변화가 더욱 명확하게 드러났습니다. Nanochat이라는 오픈 소스 프로젝트는 GPT-2 수준의 모델을 단일 노드에서 8× NVIDIA H100 GPU를 사용하여 불과 2시간 만에 훈련할 수 있게 되었다고 밝혔습니다. 이 소식은 AI 업계에 큰 반향을 일으켰으며, GPT-2 모델 훈련의 가능성을 새롭게 제시했습니다.

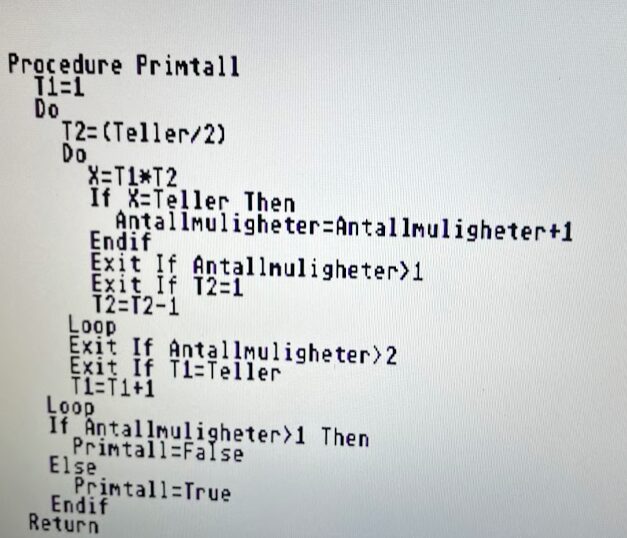

Nanochat 프로젝트의 핵심은 효율적인 훈련 파이프라인 구축에 있습니다. 불필요한 단계를 제거하고, 병렬 처리를 극대화하며, 메모리 사용량을 최적화하는 등 다양한 기술적 노력을 기울였습니다. 또한, NVIDIA H100 GPU와 같은 최신 하드웨어를 활용하여 훈련 속도를 더욱 향상시켰습니다. 이러한 노력 덕분에 Nanochat은 이전보다 훨씬 짧은 시간에 고품질의 GPT-2 모델을 훈련할 수 있게 된 것입니다.

단 2시간 훈련? Nanochat이 가져온 의미와 한계

물론, 2시간이라는 짧은 훈련 시간은 놀라운 결과이지만, 몇 가지 고려해야 할 부분도 있습니다. 첫째, NVIDIA H100 GPU와 같은 고성능 하드웨어가 필요하다는 점입니다. 일반적인 환경에서는 동일한 결과를 얻기 어려울 수 있습니다. 둘째, GPT-2 모델 자체가 상당히 큰 모델이며, 훈련 데이터셋 또한 방대하다는 점입니다. 따라서, 이보다 작은 모델이나 데이터셋을 사용하는 경우에는 훈련 시간이 더 짧아질 수 있습니다.

하지만 이러한 한계를 고려하더라도 Nanochat 프로젝트의 의미는 매우 큽니다. GPT-2 모델을 단 2시간 만에 훈련할 수 있다는 사실은 AI 모델 훈련의 가능성을 크게 확장시키고 있으며, 더 많은 사람들이 AI 개발에 참여할 수 있는 기회를 제공하고 있습니다. 또한, Nanochat의 기술적 노하우는 다른 AI 프로젝트에도 적용될 수 있으며, 전반적인 AI 기술 발전에 기여할 수 있습니다. 특히, GPT-2 모델의 경량화 및 효율적인 훈련 방식에 대한 연구는 앞으로도 지속될 것으로 예상됩니다.

AI 발전, 업계에 어떤 영향을 미칠까? 그리고 미래는?

Nanochat 프로젝트를 통해 GPT-2 모델 훈련 시간이 획기적으로 단축되면서, AI 업계는 더욱 빠른 속도로 발전할 것으로 예상됩니다. 모델 개발 주기가 단축되고, 새로운 아이디어를 빠르게 실험해 볼 수 있게 되면서, AI 기술의 혁신이 더욱 가속화될 것입니다. 또한, GPT-2 모델과 같은 대규모 언어 모델(LLM)의 접근성이 높아지면서, 다양한 분야에서 LLM을 활용한 서비스가 등장할 것으로 기대됩니다.

예를 들어, 챗봇, 번역, 콘텐츠 생성, 검색 엔진 등 다양한 분야에서 LLM을 활용한 혁신적인 서비스가 등장할 수 있습니다. 또한, LLM은 개인 맞춤형 교육, 의료 진단, 금융 분석 등 다양한 분야에서도 활용될 수 있습니다. GPT-2 모델 훈련의 효율성이 높아짐에 따라, 이러한 가능성은 더욱 현실화될 것입니다. 앞으로 AI 기술은 우리 삶의 다양한 측면에 깊숙이 침투하여 혁신을 이끌어낼 것으로 보입니다.

심층 분석 및 시사점

- NVIDIA H100 GPU 활용: 고성능 GPU를 활용하여 훈련 속도를 획기적으로 향상시켰습니다.

- 효율적인 훈련 파이프라인 구축: 불필요한 단계를 제거하고 병렬 처리를 극대화하여 훈련 효율성을 높였습니다.

- 데이터셋 최적화: 고품질의 데이터셋을 활용하여 모델의 성능을 향상시켰습니다.

- 모델 경량화 기술: GPT-2 모델의 크기를 줄여 훈련 시간을 단축하고, 리소스 사용량을 절감했습니다.

- 분산 훈련 기술: 여러 노드를 활용하여 모델을 분산 훈련함으로써 전체 훈련 시간을 단축했습니다.

원문 출처: Nanochat Can Now Train a GPT-2 Level Model in Just 2 Hours

한국어

한국어  English

English 日本語

日本語